Google AdSense 下号了,开心

历时一个月,七次申请,终于批号了,哈哈,开心,其实也没想到这个站竟然能通过审核,因为之前一直都是被拒的,所以昨天又另外搞了一个站打算如果再被拒,就换站试试了,结果竟然下号了,哈哈,开心,大概记录一下这一个月的操作,不过这些操作不一定是通过审核的因素,感觉跟审核的人可能也有些关系。

第一次申请,网站内容很少,大概十几条文章还是去年发的,然后就一直没管过,google有12条的收录,流量零,结果毫不意外,被拒,被拒之后,因为登陆adsense后,提示说是网站上发现一些违规问题,还一度以为是网站内容不符合google政策,所以被拒了。

第二次申请,怀疑网站内容不行,所以直接就换了另外一个旅游类型的网站,也是只有几十条文章,也是去年发的,google的收录自然也不多,流量也是零,结果也是毫不意外的被拒,不过这次被拒确定不是因为网站内容不符合google政策,应该是网站内容太少所以被拒的。

第三次申请,仍然使用第一次申请用的网站,增加了几十条文章,整站大概有50多条的文章,文章都是直接复制粘贴的,没有做伪原创,只是把发布时间均匀分布了一下,假装是去年到现在不间断更新的,然并卵,还是被拒了,被拒的邮件还是一样的

Site does not comply with Google policies: We're unable to approve your AdSense application at this time because your site does not comply with the Google AdSense program policies or adhere to the Webmaster Quality guidelines. It's our goal to provide our advertisers sites that offer rich and meaningful content, receive organic traffic, and allow us to serve well-targeted ads to users. We believe that currently your site does not fulfill this criteria.

Here are some recommendations to help you improve the user experience on your site and comply with AdSense criteria:

- It’s important for sites displaying Google ads to offer significant value to the user. As a publisher, you must provide unique and relevant content that gives users a reason to visit your site first.

- Don’t place ads on auto-generated pages or pages with little to no original content.

- Your site should also provide a good user experience through clear navigation and organization. Users should be able to easily click through your pages and find the information they’re seeking.

第四次申请,因为之前加了几十篇文章仍然被拒,所以没有被拒后马上申请,打算每隔两天更新一下,等了几天,这几天也更新了两条文章,然后google的收录增加了一些,结果还是一样的,被拒,不过这次被拒发的邮件跟之前三次不一样,增加了一些内容

Insufficient content: To be approved for AdSense and show relevant ads on your site, your pages need to have enough text on them for our specialists to review and for our crawler to be able to determine what your pages are about.

To resolve this issue, please work through the following suggestions:

- Make sure that your pages have sufficient text - websites that contain mostly images, videos or Flash animations will not be approved.

- Your content should contain complete sentences and paragraphs, not only headlines.

- Ensure that your website is fully built and launched before you apply for AdSense - do not apply while your site’s still in a beta or “under construction” phase or only consists of a website template.

- Place the ad code on a live page of your website. It does not have to be the main page, but test pages that are empty except for the AdSense ad code will not be approved.

- Provide a clear navigation system for your visitors so that they can easily find all of the sections and pages of your website.

- If you’d like to monetize YouTube videos, please apply for the YouTube monetization program. Note that blogs and websites that contain only videos will not be approved.

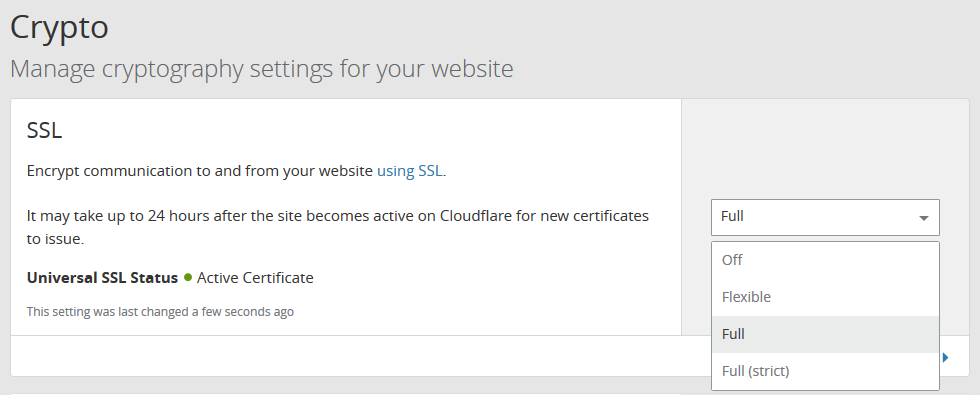

直接说内容不足了,既然这样,那就再加些内容好了,本来想着直接加到100条文章的,结果比较懒,复制粘贴到85条就懒得再加了,也是等了几天,google site到60多条记录,实际放出来的收录有20多条,然后这几天也开始每天刷点流量,另外也给网站加上了https,结果被拒了,被拒的原因有点尴尬

Unable to review your site: While reviewing

http://domain, we found that your site was down or unavailable. If you applied through an AdSense host partner, such as YouTube or Blogger, your hosted site was not available or not found (removed) at the time of the review.

无法查看网站,什么鬼,已经对http做301跳转到https了,怎么会无法打开网站,这还真是奇怪了。

第六次申请,因为上次被拒原因有点尬,所以改成直接用https的网址申请,google site查到100多条收录,放出来30多条,继续每天刷着流量,然结果仍是被拒,被拒邮件又跟一开始一样样了。

第七次申请,感觉估计还是站不行,所以一直被拒,打算再被拒的话,就准备换站试试了,这次也只是增加了7条文章,还是没能加到100条,哈哈,只有92条文章,google的收录倒是增加了不少,不知道是不是因为这几天一直有刷着流量的原因,site查到200多条记录,放出来的不多还是只有30多条。

本来想着应该还是会被拒,等了三天,结果,哈哈,今天打开邮箱一看,竟然是获批的邮件,意外不意外,惊喜不惊喜,从5月28号到6月27号,历时整整一个月,Google AdSense终于下号了,嗯,用的是英文站,申请的是美号。

总结,其实也没啥可总结,因为套路并没有摸清楚,对google adsense的审核标准也还是不了解,不过有个百十来篇文章,适当刷点流量,每天有百十来个IP应该就可以了,最好是文章的内容可以适当的搞一搞,如果纯复制粘贴,可能不太容易过,也可能是复制粘贴选的源站不咋的,像我被拒这么多次一样,搞不好也是运气,碰巧最后这次审核的人标准比较宽松,哈哈,所以不好说呢,毕竟是人工审核。

其实说起来这都不算是第一个google adsense账号了,在很久很久以前,大概2010年就下过一个号了,是不是很久了,呵呵,国号,也是申请了好多次过的,不过那会下号之后,emmm~就只是下了一个号,然后就一直都木有搞,说来还真是惭愧,至今那个号也才十多刀吧,算了,不多说了,说多了都是泪,搞站搞站,搞流量搞流量,没有流量,神马都是浮云,搞起来~